原创AI技术博客

探索人工智能与大模型最新资讯与技术博客,涵盖机器学习、深度学习、自然语言处理等领域的原创技术文章与实践案例。

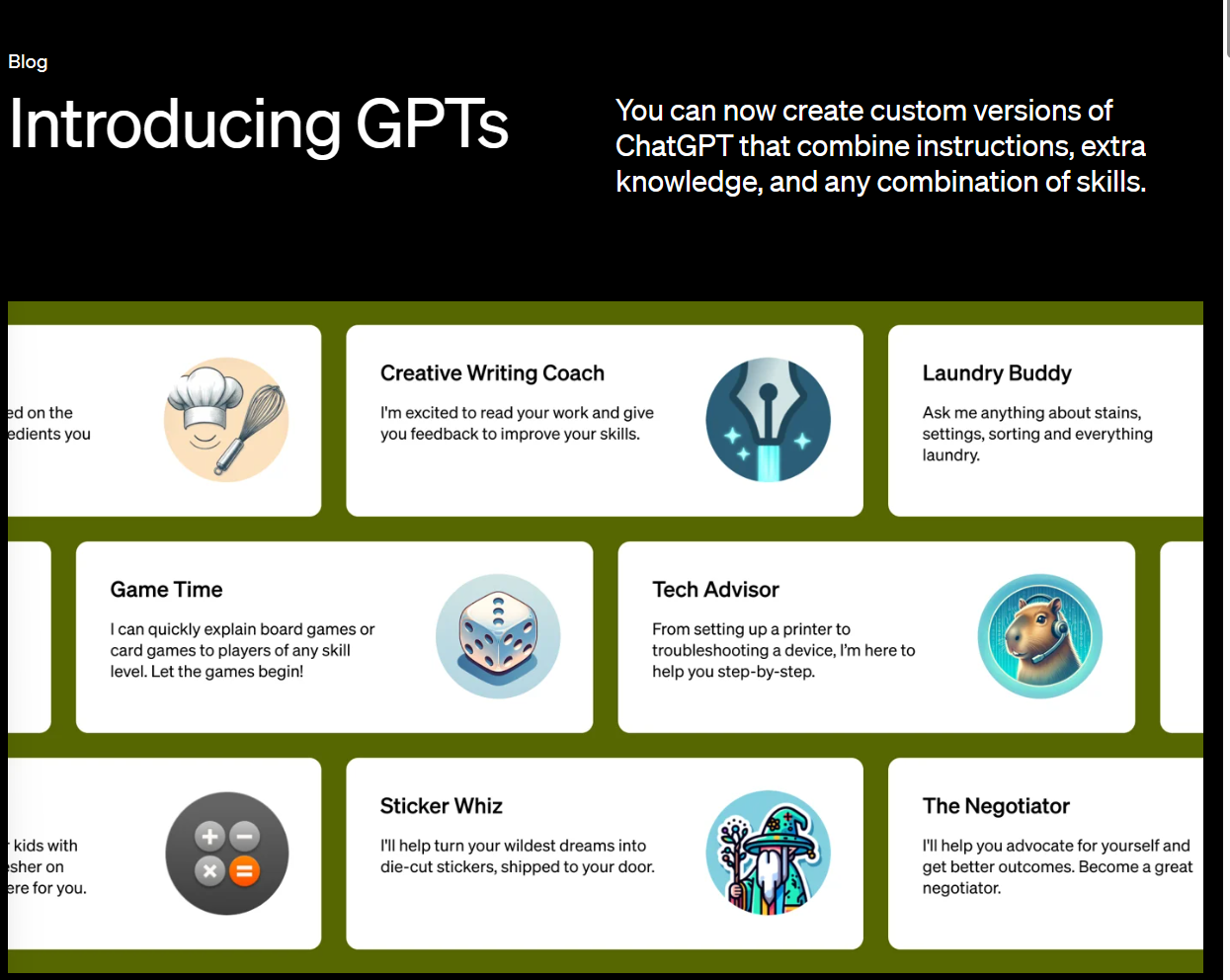

来自OpenAI的官方解释:ChatGPT中的GPTs与Assistants API的区别是什么?有什么差异?

OpenAI发布的产品中,有2个产品可以用来将GPT当作一个类似AI Agent工具使用,同时支持接入自定义的接口和数据。那就是GPTs和Assistant API,前者可以在界面直接操作,后者则是一个API,两者功能接近,为了让大家更加清晰理解二者区别,OpenAI官方最近发布了二者的解释。