70亿参数规模大模型新选择:Deci开源DeciLM-7B大模型,评测效果远超Llama2-7B,每秒可生成328个tokens。

DeciAI是一家成立于2019年的以色列企业,他们最主要的产品是深度学习平台Deci,可以让大家部署运行更快、更准确的模型。包括Adobe、HPE等都是他们的客户。在昨天,他们开源了截止目前可能是Open LLM Leader综合评分最高的大语言模型DeciLM-7B以及指令优化版本的DeciLM-7B-Instruct。最重要的是,这个模型以Apache2.0的协议开源,可以免费商用。

DeciLM-7B简介

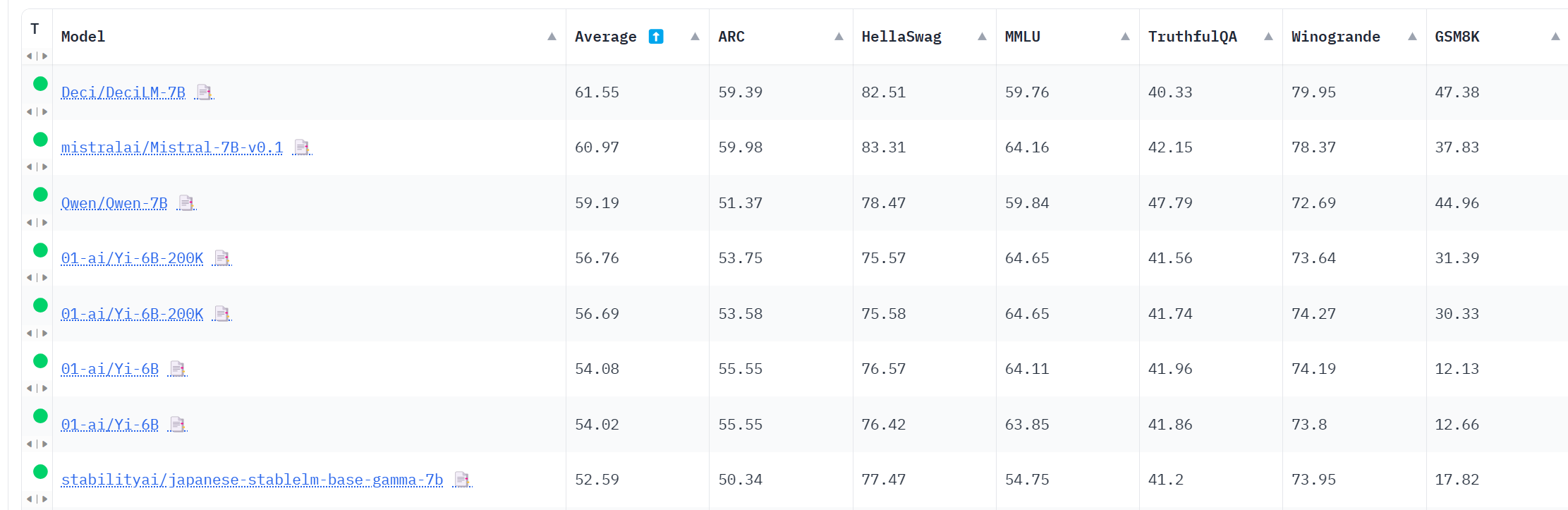

DeciLM-7B模型是一个参数规模为70.4亿的大语言模型。它是DeciAI自己从头训练的大语言模型。其模型架构虽然没有完全公开,但是从官网提供的信息看是一个非常具有创新性的transformer架构,是一个速度与效果均衡的大语言模型,作为一个预训练模型,它在各项评测得分中都有很好的结果,综合成绩目前是70亿参数预训练模型中Open LLM Leader排行榜第一。

Open LLM Leader是HuggingFace4H在HuggingFace上创建的一个排行榜,用以跟踪大模型在各个评测上的得分结果。其中,模型可以按类别和参数规模分组。这个榜单的访问量很高,也是很多人关注的一个榜单。它可以自动地评估模型在不同评测任务上的得分结果。而目前,70亿参数预训练模型的综合的份上,DeciLM-7B第一,略超第二名的Mistral 7B模型。

DeciLM-7B是一个基础语言模型,同时发布的还有一个指令调优的语言模型DeciLM-7B Instruct,而这两个模型的预训练结果都是以Apache 2.0协议开源的,所以可以完全免费商用。

DeciLM-7B模型的技术细节

尽管官方没有公布DeciLM-7B的详细信息,但是还是公布了一些技术小细节。首先,DeciLM-7B采用了DeciAI自家的神经网络架构搜索引擎创造,同时采用了一种新的Grouped Query Attention技术。可以结合Multi-Query Attention的速度和Grouped Query Attention的效果。简单来说就是部分层使用MQA,部分层使用GQA。但是没有公布更多细节。

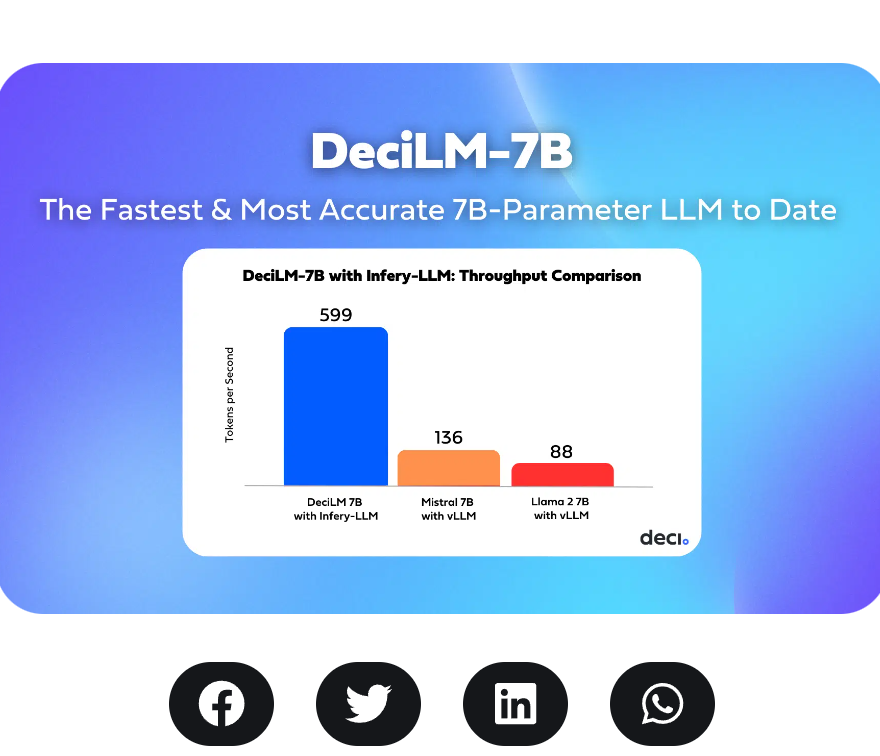

这个技术采用的效果就是DeciLM-7B的运行速度非常快!按照官方的描述,基于PyTorch实现的DeciLM-7B的速度则是正常情况下7B模型的好几倍。如下图所示,在A100上,DeciLM-7B每秒生成的tokens数量达到328个,是Mistral 7B的1.83倍,是Llama2-7B的2.39倍!

前面提到过DeciAI是做平台软件出身的。因此,他们的主要目的还是卖自己的推理平台Infery-LLM,而在Infery-LLM上运行DeciLM-7B那就更快了,可以达到每秒599个tokens。Infery-LLM可以理解为闭源的vLLM框架。

DeciLM-7B的评估结果

下面是DeciLM-7B模型的具体评估结果:

| 模型 | Leaderboard | ARC | HellaSwag | MMLU | Truthful QA | Winogrande | GSMBK | |---|---|---|---|---|---|---|---|---|---| |DecilLM-7B-instruct|63.19|61.01|82.37|60.24|49.75|79.72|46.02| | DeciLM 7B-Base | 61.55 | 59.39 | 82.51 | 59.76 | 40.33 | 79.95 | 47.38 | | Mistral-7B-v0.2 | 65.71 | 63.14 | 84.88 | 60.78 | 68.26 | 77.19 | 40.03 | | Mistral-7B-v0.1 | 60.97 | 59.98 | 83.31 | 64.14 | 42.15 | 78.37 | 37.83 | | Vicuna-13B-v1.5 | 55.41 | 57.08 | 81.24 | 56.67 | 51.51 | 74.66 | 11.30 | | Llama 2 13B-chat-hf | 54.91 | 59.04 | 81.94 | 54.64 | 44.12 | 74.51 | 15.24 | | Llama 2-7B-hf | 50.97 | 53.07 | 78.59 | 46.87 | 38.76 | 74.03 | 14.48 |

从这个表格可以看到,按照平均分估计,DeciLM-7B模型相比此前大火的Mistral-7B-v0.1版本也是略好的,但是,这个平均分的拉高主要来自GSM8K的分数,而MMLU的得分还是差一点。相比较Mistral 7B v0.2则明显逊色。这说明DeciLM-7B模型本身的理解能力可能不一定比Mistral 7B强,但是数学推理可能更好。而指令微调之后,模型的各项结果都有提升,但是数学推理部分有下降。

不过可惜的是,DeciLM-7B目前只支持英文。